ChatGPT per OpenAI-API flexibler und günstiger nutzen

So besorgt Ihr Euch einen API-Schlüssel für Apps, um ChatGPT flexibler und günstiger zu nuntzen

Der Standard-Weg, ChatGPT zu verwenden, führt in den Browser. Doch es gibt noch eine zweite Möglichkeit, die Funktionen des Chat-Bots zu nutzen: Ihr besorgt Euch den API-Zugriff. Mit einem passenden Schlüssel kommt Ihr nicht nur einfacher in den Genuss neuer Funktionen wie dem erweiterten GPT-4-Sprachmodell, Ihr könnt die Dienste auch in verschiedenen Programmen und Diensten einbinden. Wie es geht? Verraten wir Euch hier!

Was bringt die ChatGPT-API?

Es gibt eine Reihe von Gründen, die ChatGPT-API zu nutzen. Der wohl wichtigste betrifft alle, die das 20-Dollar-Abo ChatGPT Plus in Erwägung ziehen: Nutzt Ihr die API, könnt Ihr die erweiterten Funktionen wie das neue GPT4-Sprachmodell unter Umständen deutlich günstiger verwenden; mehr dazu weiter unten.

Auch macht es die API möglich, die ChatGPT-Funktionen in Programme oder Webseiten zu integrieren. Das ist primär für Entwicklerinnen und Entwickler interessant – etwa, wenn Ihr auf Eurer Shop-Homepage einen KI-Chatbot einbinden wollt. Doch auch abseits von Coding-Projekten hat die API-Nutzung Vorteile.

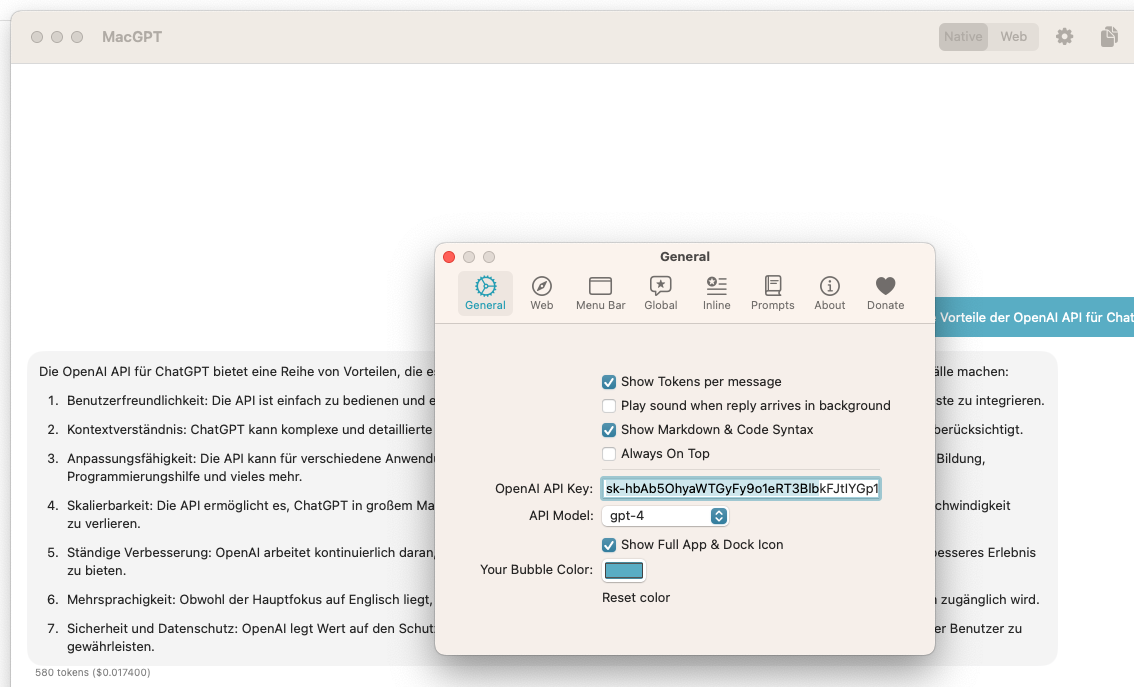

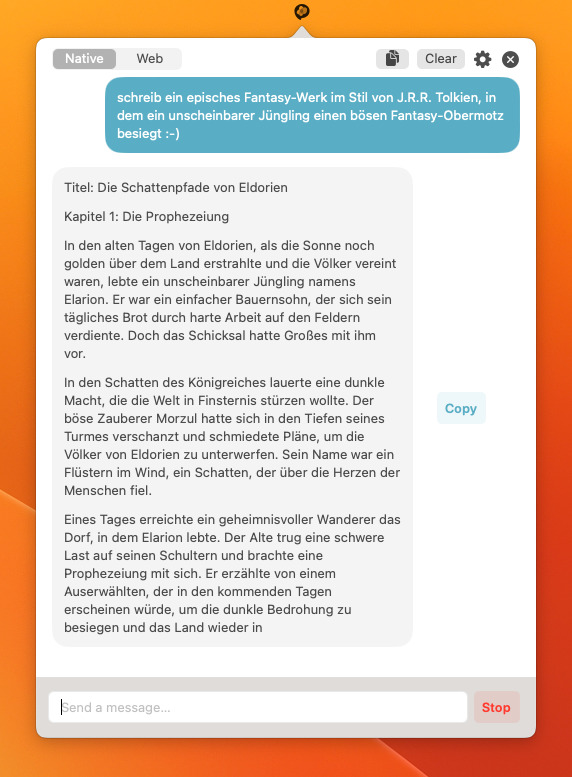

So gibt es eine Reihe von Desktop- und Mobile-Apps, die per API-Schlüssel mit ChatGPT agieren und die Vorteile des Chat-Bots greifbar machen. Beispiele dafür sind das exzellente Petey für iOS und watchOS, der ChatGPT-Mac-Client MacGPT oder auch Open-Source-Projekte wie Chat with GPT, die die Chat-Umgebung lokal verfügbar machen. Sie nutzen einen API-Schlüssel, um Eure Anfragen bei ChatGPT zu verarbeiten.

Nebenher macht die API auch mit zwei Problemen Schluss, die ChatGPT für viele Menschen zum Nervfaktor machen: die Abhängigkeit von einem Browser und die Nicht-Verfügbarkeit, wenn die Homepage mal wieder überlastet ist. Anders, als bei der klassischen Nutzung, müsst Ihr nicht immer ein Fenster öffnen, um die ChatGPT-Funktionen zu nutzen. Das bereits genannte MacGPT erlaubt es beispielsweise, systemweit über einen Schnellzugriff ChatGPT-Anfragen zu nutzen. Damit das funktioniert, müsst Ihr aber einen API-Schlüssel in dem Programm hinterlegen.

Da die API-Anfragen von OpenAI anders behandelt werden, als die Frontend-Webseite von ChatGPT, bekommt Ihr auch dann Eure Antworten, wenn die ChatGPT-Webseite mal wieder nicht funktioniert.

So erhaltet Ihr den API-Zugriff für ChatGPT

Die Anmeldung zur ChatGPT-API ist vergleichsweise einfach. Wichtigste Voraussetzung ist allerdings eine Kreditkarte, über die die Abrechnung erfolgt. Zumindest Stand dieses Tutos bietet OpenAI noch keine andere Möglichkeit, die Kosten für den API-Zugriff zu begleichen. Habt Ihr diese, müsst Ihr Euch bei OpenAI anmelden und die Kreditkarte als Zahlungsmethode hinterlegen. Die ChatGPT-Erfinder bieten dazu einen separaten Konto-Bereich, in dem Ihr Euch registrieren müsst.

Meldet Euch dort an, klickt oben rechts auf das Profilbild und wählt dann den Punkt Manage Account. Hier wechselt Ihr über das Menü auf der linken Seite in den Bereich Billing (Abrechnung). Habt Ihr noch keine Zahlungsinformationen für das Konto hinterlegt, wählt nun den Punkt Setup paid account. Entscheidet Euch, ob Ihr als Firma oder Einzelperson auftreten wollt und hinterlegt anschließend Eure Kreditkartendaten.

Sobald Ihr die Zahlungsdaten hinterlegt habt, könnt Ihr auf die API von ChatGPT zugreifen. Dazu müsst Ihr im nächsten Schritt einen passenden Schlüssel erstellen, den Ihr dann in Eure Projekte einfügen könnt.

ChatGPT-API-Keys erstellen und verwalten

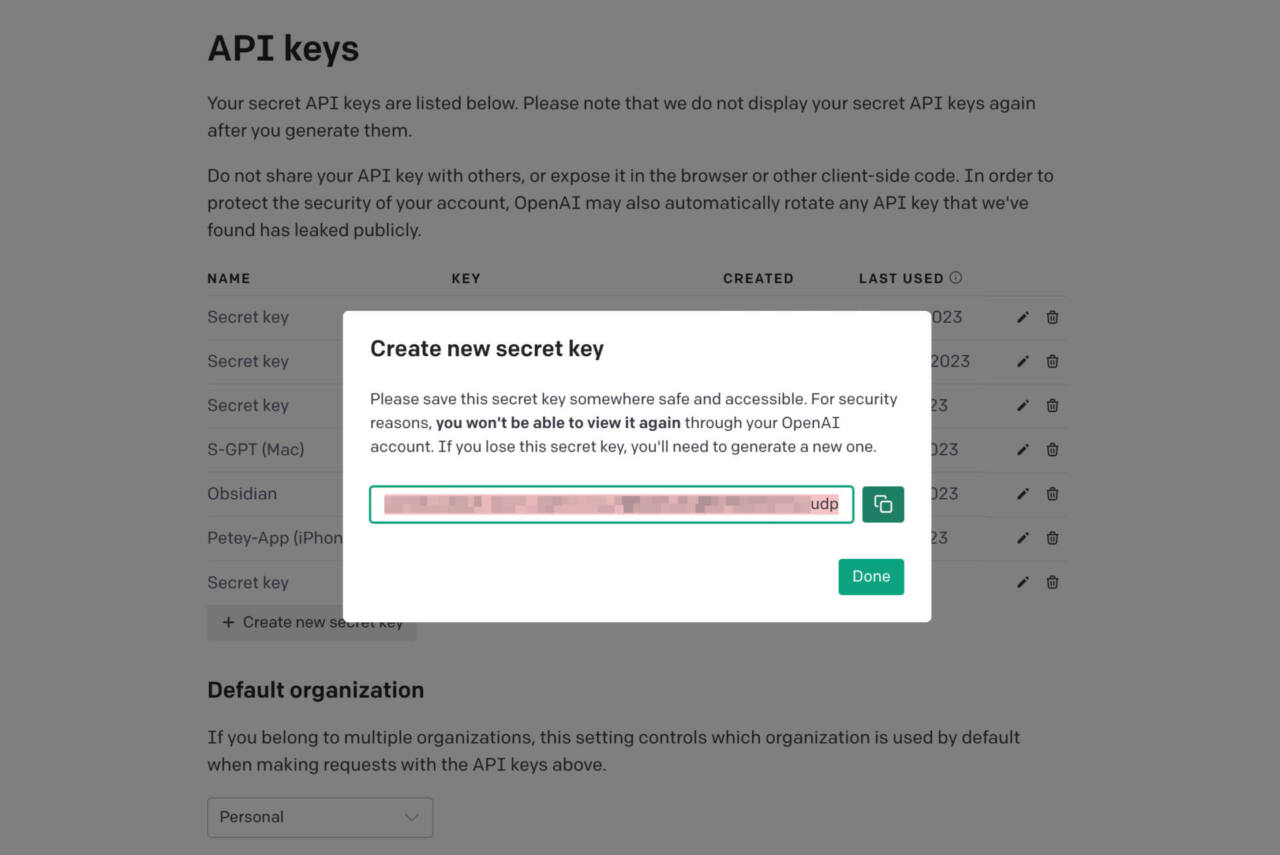

Um einen API-Schlüssel für ChatGPT zu erstellen, wechselt Ihr jetzt links in den Bereich User – API Keys. Hier könnt Ihr mit Create New Secret Key einen API-Schlüssel erstellen. Auf Wunsch dürft Ihr dabei auch gleich eine Notiz hinterlassen, wofür der Schlüssel gedacht ist. Das ist vor allem dann hilfreich, wenn Ihr den Schlüssel nur vorübergehend verwenden und später wieder löschen möchtet

Kopiert den Schlüssel in die Zwischenablage und fügt ihn anschließend in das Programm oder den Dienst ein, über den Ihr die API verwenden möchtet. Achtet dabei darauf, dass Ihr den Schlüssel aus Sicherheitsgründen nicht noch einmal zu sehen bekommt. Ihr könnt die erstellten Schlüssel später aber jederzeit löschen und neu generieren. Klickt dazu einfach auf den Mülleimer neben dem Schlüssel, den ihr hinausschmeißen wollt.

Ganz allgemein solltet Ihr die Schlüssel natürlich nur in Programmen einfügen, denen Ihr vertraut. Es gibt haufenweise Online-Seiten, die heiter nach API-Keys fragen – ob Ihr Eure durchaus wertvollen Schlüssel da hinterlegt, ist letztlich Euch überlassen, aber: Denkt immer an die guten, alten Simpsons ;-)

ChatGPT: Kosten für die API-Nutzung prüfen und Nutzungslimits einführen

Wie schon beschrieben, zahlt Ihr für den API-Zugriff keinen Pauschalbetrag. Stattdessen rechnet OpenAI nach Modell und Nutzung ab (s. unten). Der Clou: Ihr könnt die monatlichen Kosten ganz einfach deckeln, um keine bösen Überraschungen zu erleben.

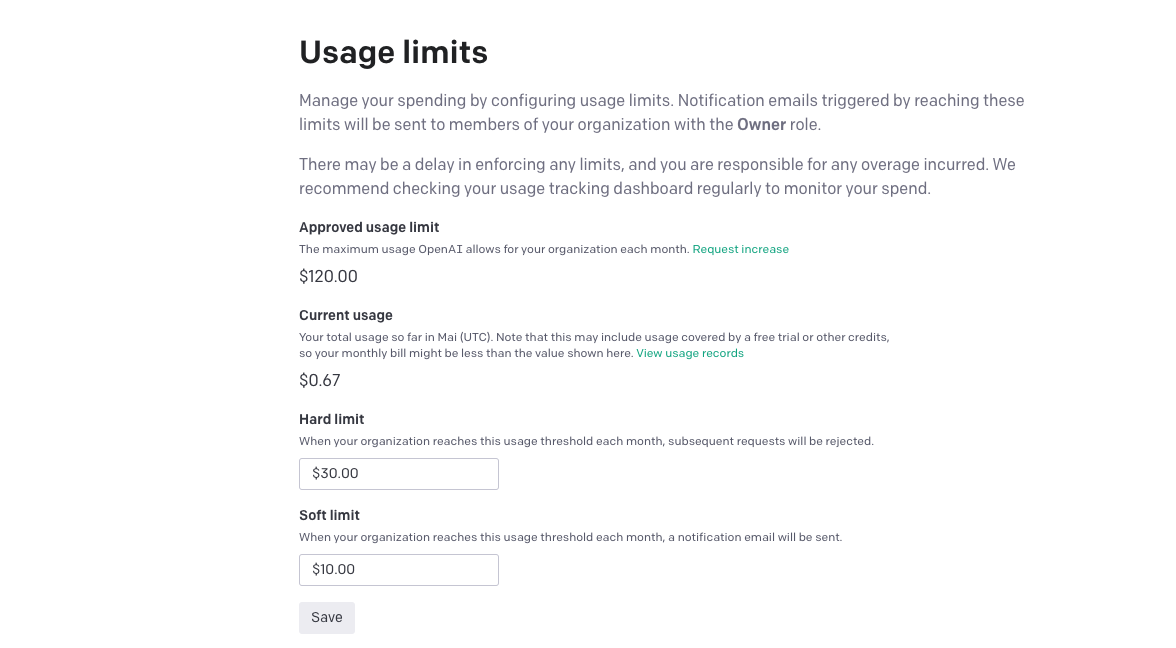

Klickt dazu im Kontenbereich links auf Billing und dann auf Usage Limits. Hier könnt Ihr mit Hard limit eine Kostenhöchstgrenze in US-Dollar eingeben. Sobald die monatliche Nutzung über Eure API-Schlüssel diesen Wert erreicht, wird der Zugriff bis zur nächsten Abrechnungsperiode gestoppt. Die Kosten werden dabei immer für alle API-Schlüssel addiert, die Ihr generiert habt.

Um böse Überraschungen zu vermeiden, könnt Ihr optional einen Wert bei Soft limit eintragen. Sobald die Kosten Eurer API-Nutzung den hier hinterlegten Dollarbetrag übersteigen, schickt Open AI Euch eine E-Mail als Hinweis.

Wenn Ihr mit den eingetragenen Limits zufrieden seid, klickt auf Save, um sie zu aktivieren. Neben der Selbstkontrolle ist die Kosteneinschränkung der API-Keys auch für Unternehmen hilfreich. Übrigens: Stand dieses Tutos erlaubt es OpenAI auch ohne die manuellen Einschränkungen, maximal 120 US-Dollar pro Monat für den API-Zugriff auszugeben. Wenn Ihr es aber überhaupt in derlei hohe Kostenspähren schafft, ist tendenziell das Monatsabo eine bessere Option für Euch.

ChatGPT-Kosten überprüfen und Rechnungen herunterladen

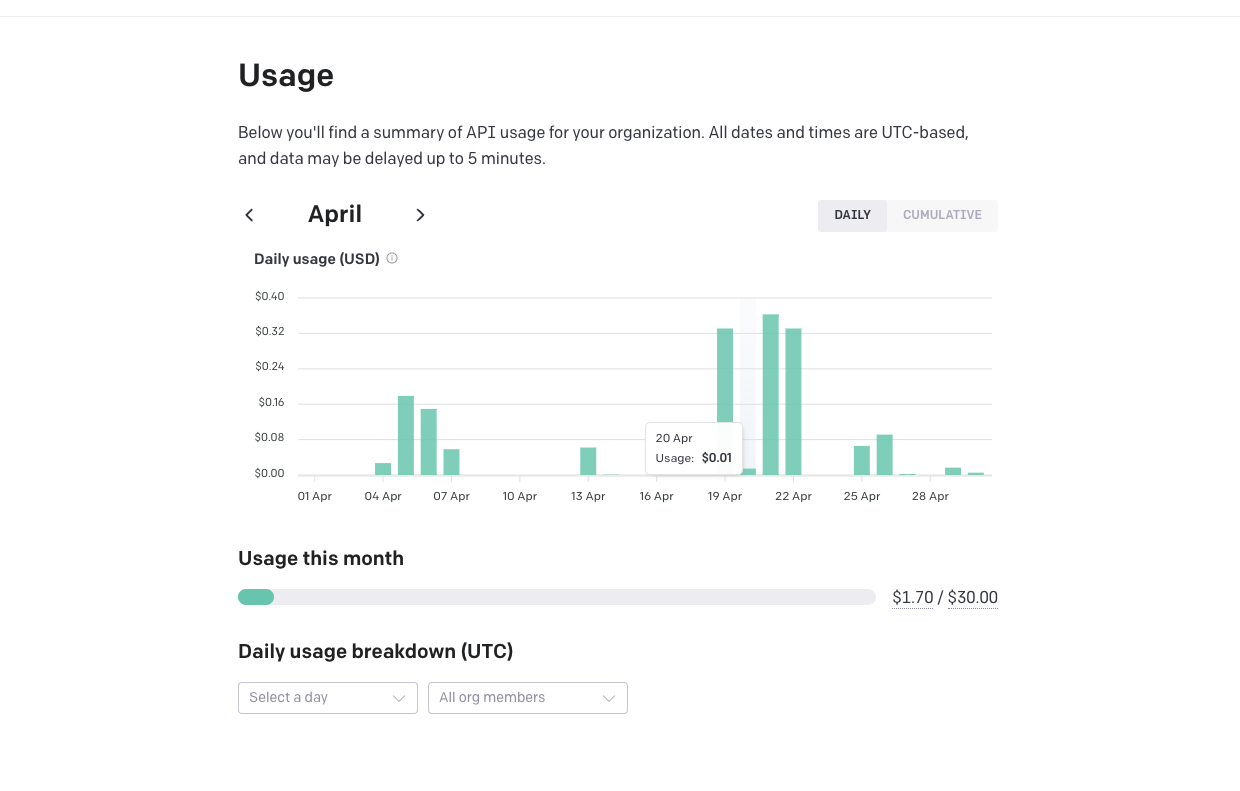

Natürlich müsst Ihr auch mit gesetzten Kostenlimits nicht blind darauf vertrauen, dass die Rechnungen für die API-Nutzung nicht aus dem Ruder laufen. In Eurem OpenAI-Konto habt Ihr jederzeit Einblick in die aktuellen und vergangenen Kosten. Klickt im Menü auf der linken Seite auf den Link Usage, um die entstandenen Kosten nach Monaten einzusehen. Fahrt mit der Maus über die Grafik, um den täglichen Verbrauch einzusehen.

Selbstverständlich könnt Ihr die Rechnungen auch jederzeit herunterladen – wegen Steuern und so. Ihr findet die Daten im Bereich Billing – Billing History. Klickt hier auf die entsprechende Rechnung, um sie zu öffnen und als PDF auf Eurem PC zu sichern.

ChatGPT: API-Zugriff statt Plus-Abonnement – lohnt sich das?

Wenn Ihr ChatGPT nur im Browser verwendet, verpasst Ihr unter Umständen einiges – und gebt zu viel Geld aus :-) Einer der Vorteile der API-Nutzung ist, dass die Funktionen des ChatGPT-Plus-Abos auf einem „Bezahlt nur, was Ihr benötigt“-Modell nutzen könnt. Soll heißen: Statt Open AI für den Vollzugriff monatlich 20 Dollar (… oder was auch immer der Service kosten wird, wenn sich die Betreiber entscheiden, die horrenden Kosten wieder reinzuholen) in den Rachen zu werfen, könnt Ihr mit der API-Nutzung unter Umständen einiges sparen.

OpenAI rechnet dabei in „Token“ ab, was ein wenig Abstraktion erfordert. Ein Token kann dabei ein Wort, ein Zeichen oder eine andere Einheit sein, je nachdem, womit das Modell arbeitet. Die Anzahl der Tokens beeinflusst direkt Eure Kosten für die API-Nutzung. Beachtet dabei, dass sowohl die eingegebenen Anfragen als auch die vom Modell generierten Antworten in die Abrechnung einfließen. Wie teuer eine Anfrage bzw. ein Chat ist, hängt neben der Länge der Anfragen auch vom gewählten Sprachmodell ab. Das GPT-3-Modell, mit dem ChatGPT im vergangenen Jahr an die Öffentlichkeit gegangen ist, kostet *deutlich* weniger als das leistungsfähigere GPT4 – wir reden hier ungefähr vom Faktor 20.

Open AI hat auf seiner Homepage eine Übersicht über die Token-Preise, anhand der Ihr die groben Kosten überschlagen könnt. Etwas weniger abstrakt könnt Ihr die API-Kosten hier nachvollziehen:

In den Rechner könnt Ihr für die verschiedenen Sprachmodelle und die Länge von Texten, die Ihr erstellen wollt, die zu erwartenden Kosten eingeben.

Demnach kostet es rund 5,70 US-Dollar, wenn Ihr den Hobbit von J.R.R. Tolkien per ChatGPT-4-API nachschreiben wollt. Reicht Euch die Sprachqualität von ChatGPT 3.5 kommt Ihr hingegen mit gerade einmal 25 Cent davon. Ein Schnapper für eine epische Reise in eine fremde Fantasywelt, gell ;-)?

Das ist natürlich nur ein Beispiel dafür, was die API-Nutzung kostet. Selbst im teuersten Fall könnt Ihr also eine ganze Menge Chats mit ChatGPT austauschen, um auf die 20 Dollar des Premium-Abos zu kommen. Natürlich könnt Ihr einfach auf den ganzen Kram verzichten und Euch in Microsoft-Schlund begeben. Die von Christian gefeierte Bing-Integration von ChatGPT ist kostenlos und nutzt das aktuellste GPT-4-Modell.

Aber mir persönlich geht einfach die Art und Weise auf die Nerven, wie Microsoft mit der Brechstange seine (immer noch weitestgehend nutzlose) Bing-Suche in einfach _jedes_ Programm zwängt. Wenn Ihr in den vergangenen Wochen ein Windows-Update gemacht und die Bing Desktop-Suchleiste gesehen habt, wisst Ihr, was ich meine. Deswegen vermeide ich derzeit wirklich alles von Microsoft und bleibe lieber direkt beim „Original“, wenn ich irgendwas mit ChatGPT machen will.

Wie oben beschrieben ist es relativ einfach, die API-Kosten per Preislimit zu deckeln. Wenn Ihr so viel Redebedarf habt, dass Ihr dennoch an die Grenzen der Kosten kommt, könnt Ihr natürlich jederzeit über ein Standard-Abo nachdenken. Oder ohne KI durchs Leben gehen. Wie haben wir das eigentlich gemacht, bis vor… öhm… knapp einem Jahr …?

Wie ist das eigentlich bei Euch: Nutzt Ihr ChatGPT überhaupt? Ist die API-Option für Euch von Interesse? Oder seid Ihr gar mit den Möglichkeiten der Gratis-Version oder auch der Bing-Interpretation mehr als zufrieden? Lasst es uns gerne in den Kommentaren wissen. Ich bin immer noch nicht davon überzeugt, dass ich wirklich großen Nutzung aus dem Dienst ziehen kann. Andererseits ist das Ganze ja immer noch alles früh und die Entwicklung rasant…

Noch mehr zum hoffentlich eines Tages wieder abflachenden KI-Hype findet Ihr hier, ganz andere Themen sammeln wir unter diesem Link für Euch.