DiffusionBee: KI-Bilder ganz einfach zuhause erstellen

KI-Bilder mit auf dem heimischen Rechner erstellen? Dank DiffusionBee und Charl-E kein Problem. Die Ergebnisse sind... bemerkenswert. Und von echter Intelligenz weit entfernt.

Wir stecken mitten in der KI-Revolution: Künstliche Intelligenz ist auf dem Vormarsch, und es ist nicht ganz ausgeschlossen, dass das noch bis zum Ende der Dekade einige unangenehme Nebeneffekte haben könnte. Bisher sind die KI-Tools allerdings eher Spielerei, vor allem, wenn es um die Erstellung von KI-Bildern, sogenannter „AI-Art“ geht. KI-Bild-Tools wie Dall-E2, Imagegen und Stable Diffusion generieren Fotos und Kunstwerke ausschließlich anhand der Texteingabe des Users. Und das geht jetzt auch lokal und kostenlos auf Eurem PC oder Mac: Die Tools heißen DiffusionBee und Charl-E.

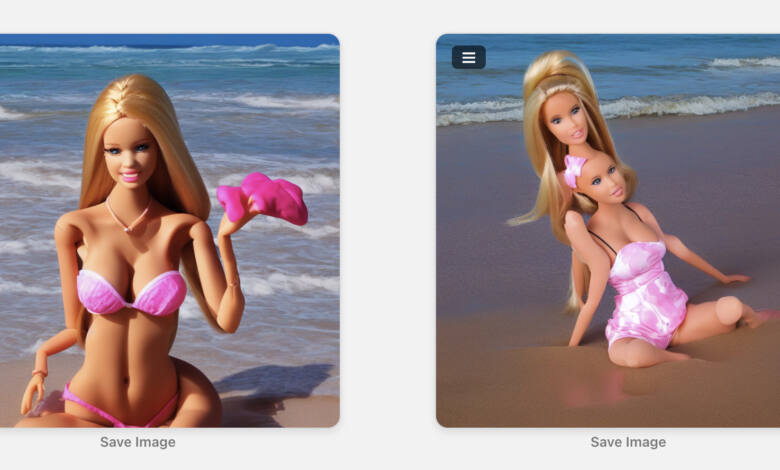

Die Resultate dieser KI-Künstler sind… nunja… oft verstörend. Trotzdem ist die Bildgenerierung mittels Künstlicher Intelligenz absolut faszinierend. Dummerweise hat sie einen großen Nachteil: Sie braucht ordentlich Rechenleistung, weshalb die entsprechenden Dienste ihre Generatoren nur teilweise kostenlos anbieten. Bei Dall-E2 ist nach monatlich 15 Bildern Schluss, wer den weitestgehend kostenlosen Stable-Diffusion-Generator nutzt, muss mit Wartezeiten rechnen.

Charly und die Diffusions-Biene

Zum Glück gibt es aber noch eine dritte Möglichkeit: Stable Diffusion wurde nämlich inzwischen auch als App für Mac und Windows umgesetzt: Mit den Tools Charl-E und DiffusionBee erhaltet Ihr die Möglichkeit, den KI-Bildgenerator lokal und ohne Zusatzkosten – vom gottlosen Strompreis derzeit einmal abgesehen – auf Eurem Rechner auszuführen. Während Charl-E nur für Macs erhältlich ist, gibt es DiffusionBee inzwischen zumindest auch als Beta mit Warteliste auch für Windows-Systeme.

Erste Schritte mit Charl-E und DiffusionBee

Mac-Nutzer mit ARM-Macs sind in Sachen KI-Bildgeneratoren also derzeit klar im Vorteil. Warum das so ist? Möglicherweise wegen der leistungsstarken und effizienten ARM-Prozessoren, die eigene Machine-Learning-Kerne in Form der „Neural Engine“ an Bord haben. Dementsprechend liegen beide Tools für Macs mit ARM-Architektur vor, aber nur DiffusionBee ist auch für Intel-Plattformen zu haben.

Die Installation von DiffusionBee ist denkbar einfach: Installiert die App wie gehabt, indem Ihr sie in den Programme-Ordner zieht. Bei ersten Start verlangt das Programm, dass Ihr die Stable-Diffusion-Modelldaten herunterladet, rund 4 Gigabyte an Daten: Dabei handelt es sich um die Trainingsdateien und andere Informationen, die die KI benötigt, um zu funktionieren.

Charl-E funktioniert auf die gleiche Weise und benutzt die gleiche KI-Engine von Stable Diffusion, ist aber mit deutlich weniger Funktionen ausgestattet, weshalb wir an dieser Stelle für weitere Erklärungen DiffusionBee zur Hand nehmen.

Gute Ergebnisse mit DiffusionBee/Stable Diffusion erzielen

Sind die Daten geladen, kann es auch schon losgehen: Gebt im Reiter „Text to Image“ eine Anfrage im Textfeld ein und schaut, was dabei herauskommt. Die Generierung dauert in der Grundeinstellung je nach Rechenleistung Eures Macs zwischen wenigen Sekunden und ein, zwei Minuten.

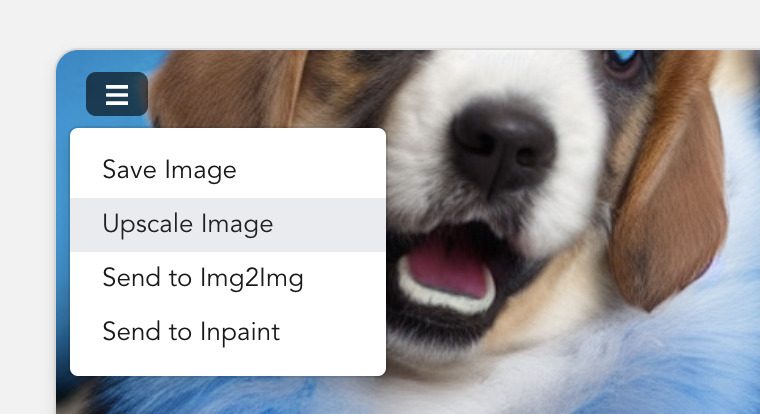

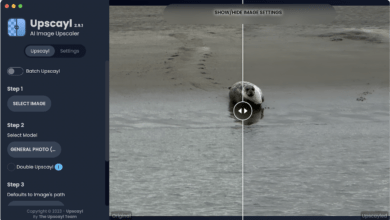

DiffusionBee hat einen praktischen Upscaler an Bord, Ihr könnt also Rechenzeit sparen, indem Ihr die Voreinstellungen beibehaltet und erst einmal einzelne kleine Bilder generiert und diese anschließend per Klick auf das Hamburger-Menü und „Upscale Image“ hochskaliert. Über dieses Menü könnt Ihr das Bild natürlich auch abspeichern. So weit, so einfach.

Natürlich setzen die DiffusionBee-Macher in den Grundeinstellungen auf Geschwindigkeit. Ein M1/M2-Macbook oder ein neuerer Intel-Mac erledigen den Generierungs-Job auf diese Weise relativ flott. Wer seinen Rechner ans Limit bringen will, sollte deshalb einen Blick in die Optionen werfen: Hier könnt Ihr die Zahl der zu generierenden Bilder einstellen, die Batch-Größe (Zahl der gleichzeitig generierten Bilder) hingegen nicht: Hier meldet DiffusionBee einen Fehler. Interessanter ist sowieso die Möglichkeit, die Auflösung einzustellen. Die ist standardmäßig bei 512×512 Pixeln, 768 Pixel im Quadrat sorgen aber natürlich für mehr Details. Die Zahl der Schritte (25) könnt Ihr zunächst beibehalten. Die KI-Genauigkeit könnt Ihr ein wenig hochsetzen, etwa auf einen Wert von 10, denn der KI-Hund ist nicht wirklich das, was ich mir vorgestellt habe. Die KI war mir an dieser Stelle „zu kreativ“, je höher der Wert des Reglers, desto weniger Freiheiten lasst Ihr ihr.

Das war es auch schon: Klickt jetzt einfach noch einmal auf „Generate“ und kocht Euch in Ruhe einen Kaffee oder lest ein kurzes Buch wie… die drei Herr-der-Ringe-Bände*. Oder Ihr macht einen kleinen Urlaub. Aber Spaß beiseite: Zumindest auf meinem iMac Pro hier – und der hat noch Intel-Technik – ist der Job innerhalb weniger Minuten erledigt. Freundlicherweise gibt die DiffusionBee auch die ersten Ergebnisse direkt im laufenden Prozess aus, Ihr könnt die Ergebnisse also schon einmal begutachten.

Falls die KI komplett daneben liegt, könnt Ihr sie mit einem beherzten Klick auf „Stopp“ auch von weiterer Stromverschwendung abhalten – oder Ihr schaut einfach, was sie Euch noch so serviert, denn manchmal sind die Ergebnisse durchaus interessant. In meinem Fall, dem „Photo of a monster puppy with blue fur“ allerdings nicht: Ich wollte keine Hundebilder, sondern einen Monsterwelpen – was die KI ganz offensichtlich nicht richtig verstanden hat.

KI-Bilder: Bessere Syntax sorgt für bessere Bilder

Genau deshalb ist es so wichtig, bei der ganzen Chose den Blick auf die Syntax zu lenken: Wie bei allen Computeranwendungen gilt auch bei DiffusionBee/Stable Diffusion: Garbage in = Garbage out. Insofern ist es wichtig, dass Ihr der KI möglichst genau beschreibt, was Ihr haben möchtet, und das idealerweise auf Englisch, da die KI-Trainingsdaten ebenfalls englisch getaggt sind. So ist das DaVinci-Bild eines Spielzeug-Roboters auf einem Motorrad schon eher das, was ich mir vorgestellt habe:

Neue Kunstform: AI-Image-Generation

Auch wenn Künstler auf dem ganzen Erdball derzeit schlottern, weil die KI ihnen die Arbeit wegnehmen könnte: Ich persönlich glaube, dass die Generierung mittels KI-Bildgenerator an sich bereits jetzt zu einer Kunstform geworden ist. Denn die Fähigkeit, eine Eingabe so zu gestalten, dass sie das Ergebnis bringt, das ich mir vorstelle, ist eine recht komplexe Angelegenheit: Der Anwendern muss verstehen, wie die KI „denkt“, um mit einer reinen Texteingabe ein halbwegs attraktives Bild zu generieren. Dazu ist es aber nötig, die Software mit allen möglichen Eingaben durchlaufen zu lassen und anschließend die Ergebnisse zu sichten.

Was mir dabei in der Praxis aufgefallen ist: Gerade bei technischen Objekten, Körpern und Gesichtern tut sich Stable Diffusion sehr schwer. Räder sind selten rund, Hände haben selten fünf Finger und Gesichter sind oftmals eher Pixelmatsch denn irgendetwas, das wie ein Gesicht aussieht. Die Ergebnisse bei entsprechenden Aufträgen sind oft so tief im Uncanny Valley, dass man gar nicht hinschauen möchte.

Das bedeutet im Umkehrschluss, dass die Bildgenerator-AI noch weit davon entfernt ist, die Inhalte tatsächlich zu verstehen: Ein menschlicher Künstler weiß zum Beispiel, dass ein technisches Objekt wie die Vespa oben bestimmte Proportionen und Rundungen hat, die die KI aber nicht erkennt: Stattdessen greift sie auf Analysedaten zurück und „weiß“, welche Elemente zu einer Vespa gehören. Das es sich dabei um ein Motorrad handelt, das zum Beispiel runde Räder haben muss, begreift sie nicht.

Das gleiche gilt für Mensch und Tier, kurzum: So spektakulär die KI-Bilder oft scheinen mögen, wirklich intelligent sind die Generatoren nicht. Zumindest derzeit nicht. Spaß machen DiffusionBee, Charl-E und Co. aber trotzdem.

Servus, danke für den Beitrag. Ist sehr Interessant! Grüße aus Bayern

Vielen Dank für den netten Beitrag, bleibt spannend wo uns die KI noch hinführen wird.

Auf der Suchmaschine you.com können ganz ohne App auch Ki-Bilder generiert werden. So hat das hier vorgeschlagene Foto von einem Monsterwelpen mit blauem Fell nur ca. 20 Sekunden bis zur Anzeige gedauert. Die Ki-Beschreibung funktioniert auch in deutsch, es werden aber teilweise verstörende Bilder generiert. Das Bild wurde von you.com in der Größe 768×768 Pixel erzeugt. Feine Spielerei

Danke für den Hinweis.